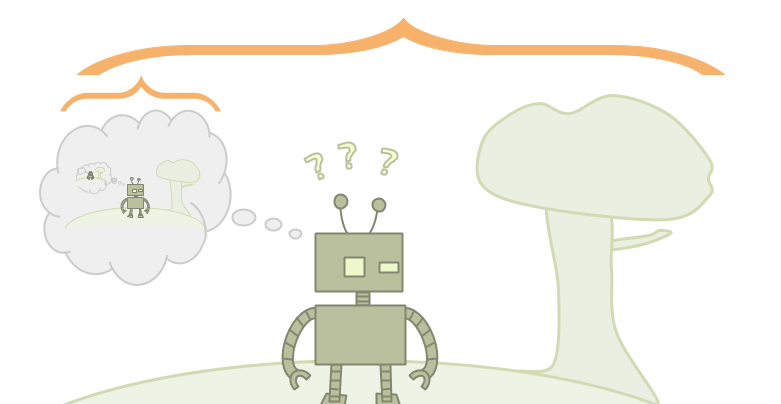

比其环境大的代理可以:

所有这些都是理性机构的概念。

一个嵌入式代理人这些事情都不能做,至少不能直接做。

其中一个难点是,由于代理是环境的一部分,因此在每个细节中建模环境将要求代理以每个细节来建模本身,这将要求代理人的自我模型成为整个代理的“大”。一个代理人无法在自己的头部内部。

缺乏一个清晰的代理/环境边界迫使我们与自我参照的悖论作斗争。好像代表世界上的其他人还不够难似的。

嵌入式世界模型必须以更适合嵌入式代理人的方式代表世界。此集群中的问题包括:

- “真实性”/“真理之粒”问题:现实世界不在代理人的假设空间

- 逻辑不确定性

- 高级型号

- 多层次模型

- 本体论的危机

- 归化诱导,代理商必须将其自身模型纳入其世界模型的问题

- 人际关系推理,有关自己的副本存在的问题

在贝叶斯环境中,在可能的世界上通过可能的世界的概率分布量化了代理的不确定性,常见的假设是“可实现性“:假设产生观察的真正潜在的环境至少有一些之前的概率。

在博弈论中,同样的属性被描述为先验有“一丝真理”。但需要注意的是,在博弈论环境中获得这一属性还存在其他障碍;因此,在它们的常用情况下,“grain of truth”是技术上的要求,而“可实现性”是技术上的方便。

为了使贝叶斯推理有意义,可实现的可实现性并不是必要的。If you think of a set of hypotheses as “experts”, and the current posterior probability as how much you “trust” each expert, then learning according to Bayes’ Law, \(P(h|e) = \frac{P(e|h) \cdot P(h)}{P(e)}\), ensures a相对界限损失财产。

具体来说,如果您使用先前的\(\ pi \),则与每个专家\(h \)相比,您与每个专家\(h \)的金额最多是大多数\(\ log \ pi(h)\),因为您至少分配概率\(\ pi(h)\ cdot h(e)\)查看一系列证据\(e \)。直观地,\(\ pi(h)\)是您对专家\(h \)的最初信任,并且在每种情况下,在每种情况下,甚至比您更具更正,你相应地增加了您的信任。您这样做的方式可确保您分配专家概率1,因此在丢失超过\(\ log \ pi(h)\)之前精确复制它。

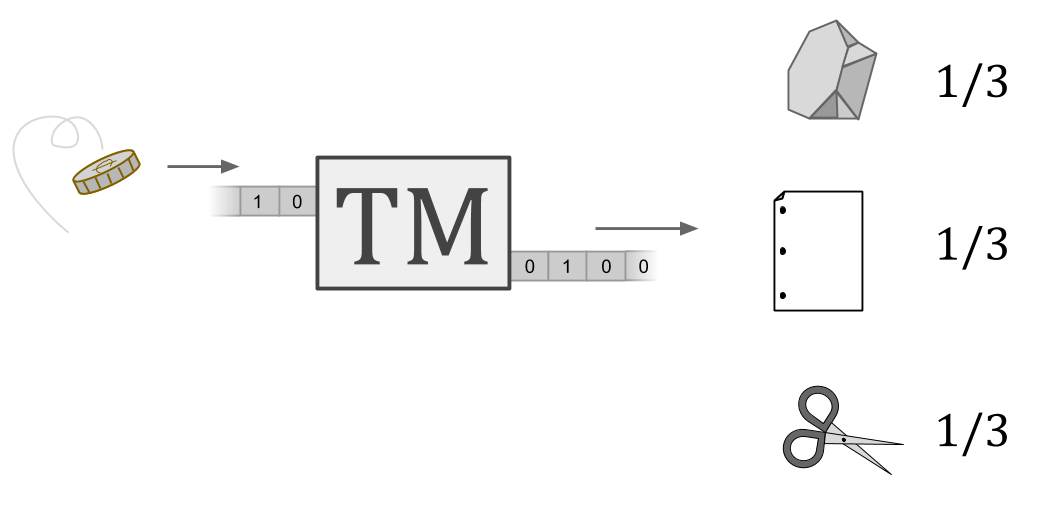

之前AIXI是基于的Solomonoff之前.它被定义为通用图灵机(UTM)的输出,其输入是硬币翻转。

换句话说,馈送UTM一个随机程序。通常,您只考虑一个utm,只能能够模拟确定性机器。然而,这里,初始输入可以指示UTM使用其余的无限输入磁带作为模拟a的随机性源随机图灵机。

结合前面的了解观察贝叶斯学习的方式分配“信任”“专家”,满足有界的损失条件下,我们可以看到Solomonoff之前作为一种理想的机器学习算法,可以学着像你可能想出任何算法,无论多么聪明。

出于这个原因,我们不应该一定将AIXI认为AIXI是“假设世界是可计算的”,即使它通过先前计算的原因也是如此。它对预测性准确性造成了有限的损失与任何可计算的预测。我们应该说AIXI假设所有可能的算法都是可计算的,而不是说世界是可计算的。

但是,如果您正在寻找超过有限损失预测准确性的任何东西,缺乏可实现性可能会造成麻烦:

- 后部可以永远振荡;

- 概率可能无法校准;

- 统计数据的估计诸如平均值可能是任意差的;

- 潜在变量的估计可能是坏的;

- 而对因果结构的识别可能不起作用。

那么在没有可实现性假设的情况下,AIXI是否表现良好?我们不知道。尽管损失有限预测没有可实现性,其现有的最优性结果行动需要一个附加的可实现性假设。

首先,如果环境真的是采样自Solomonoff分布,AIXI得到最大预期奖励.但这是相当琐碎的;它本质上是AIXI的定义。

其次,如果我们修改AIXI采取稍微随机的动作 - 汤普森采样 - 有一个渐近最优结果适用于像任何随机图灵的机器一样的环境。

所以,不管怎样,假设可实现性是为了证明任何事情。(见Jan Leike非参数一般强化学习.)

但我想说的是不是“世界可能是不可计算的,所以我们不知道AIXI是否会做得很好”;这更像是一个说明性的例子。令人担忧的是,AIXI只能通过构建代理来定义智能或理性很大,更大而不是它需要学习和行动的环境。

Laurent Orsseau提供了一种在“时空嵌入式智能”。然而,他的方法将智能定义为一种超级智能的设计者从外部考虑现实,选择一个智能进入环境.

嵌入的代理人没有奢侈的走出宇宙去思考如何思考。我们想要的是一个理性信念的理论位于代理提供的基础与贝叶斯理论为二元代理提供的基础一样强大。

想象一下,一个计算机科学理论的人与一个程序员有分歧。理论的人正在利用一个抽象的模型。程序员抱怨说,抽象模型是你永远无法运行的,因为它在计算上很棘手。理论人士回答说,关键不是要运行它。更确切地说,重点是理解一些现象,这也将与你想要运行的更容易处理的东西相关。

我把它带到了这个,以强调我的观点,就像理论人一样。我不是在谈论艾基说“艾基是你无法运行的理想化”。我指向的谜题的答案不需要运行。我只是想了解一些现象。

然而,有时是一种使一些理论模型更不可易行的东西也使得模型与我们感兴趣的现象不同。

这的方式AIXIwins games is by assuming we can do true Bayesian updating over a hypothesis space, assuming the world is in our hypothesis space, etc. So it can tell us something about the aspect of realistic agency that’s approximately doing Bayesian updating over an approximately-good-enough hypothesis space. But embedded agents don’t just need approximate solutions to that problem; they need to solve several problems that are不同的从这个问题。

嵌入式机构理论必须处理的一个主要障碍是自我参考.

自我参考的悖论如骗子悖论使它不仅仅是非常不切实际,而且在某种意义上不可能的一个agent的世界模型能够准确地反映这个世界。

说谎者悖论涉及到“这句话不是真的”这句话的地位。如果这是真的,那一定是假的;如果不是真的,那就一定是真的。

困难是部分地尝试绘制包括地图本身的领土地图。

如果世界对我们来说“静止不动”,这很好;但因为地图在世界上,不同的地图创造了不同的世界.

假设我们的目标是做出目前正在建设的道路的最终路线的准确地图。假设我们也要知道施工团队将看到我们的地图,并且施工将继续进行,以推翻我们所做的任何地图。这将我们置于一个说谎者-似是而非的情境中。

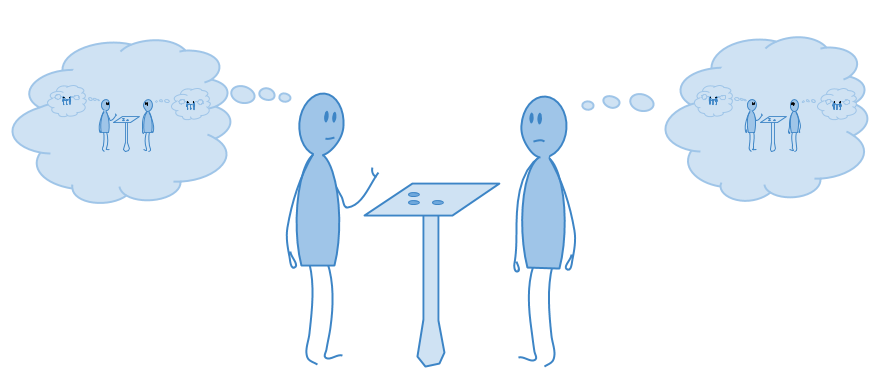

这种问题与之相关做决定在博弈论中。在一个简单的石头剪刀布游戏中,如果玩家想要获胜,就可以引入撒谎悖论,并且他们可以更好地预测彼此。

博弈论用博弈论的均衡来解决这类问题。但问题最终以不同的方式回来。

我提到,在博弈论的背景下,可实现的问题采用不同的角色。在ML设置中,可实现性是一个潜在的不切实际假设,但通常可以始终如一地假设。

在博弈论中,另一方面,假设本身可能不一致。这是因为游戏通常产生自我参考的悖论。

因为有这么多的代理商,在游戏理论中不再可能让“代理人”是一个大于世界的东西。因此,游戏理论家被迫调查理性机构的概念,可以处理一个大型世界。

不幸的是,这是通过将世界划分为“代理”部分和“非代理”部分,并以一种特殊的方式处理代理来实现的。这几乎和代理的二元模型一样糟糕。

在石头-剪刀-布中,“说谎者悖论”的解决方法是规定每个玩家都有\(1/3\)的概率下每一步棋。如果一个玩家这样玩游戏,那么另一个玩家也不会因此失去任何东西。这种引入概率博弈来解决潜在的博弈论悖论的方法被称为纳什均衡.

我们可以用纳什均衡来防止假设行为人正确地理解了他们所处的世界而不自相矛盾。然而,这只是通过告诉行为体世界是什么样子来实现的。如果我们想成为像AIXI那样了解世界的模特呢?

这真理问题是制定合理绑定的先前概率分布的问题,这将允许代理玩游戏的地方一些对彼此真实(概率)行为的积极概率,而从一开始就不知道。

直到最近,已知问题的解决方案非常有限。Benja Fallenstein,Jessica Taylor和Paul Christiano's“反思性奥卡尔:古典博弈论的基础提供了一个非常通用的解决方案。详情请参见“对真理问题的正式解决方案作者Jan Leike, Jessica Taylor和Benja Fallenstein。

您可能会认为随机图灵机可以代表纳什均衡。

但如果你想要得到纳什均衡由于对其他药剂的推理,你会遇到麻烦。如果每个代理模拟另一个的计算并尝试运行它以查看其他代理程序的功能,您刚刚获得了无限循环。

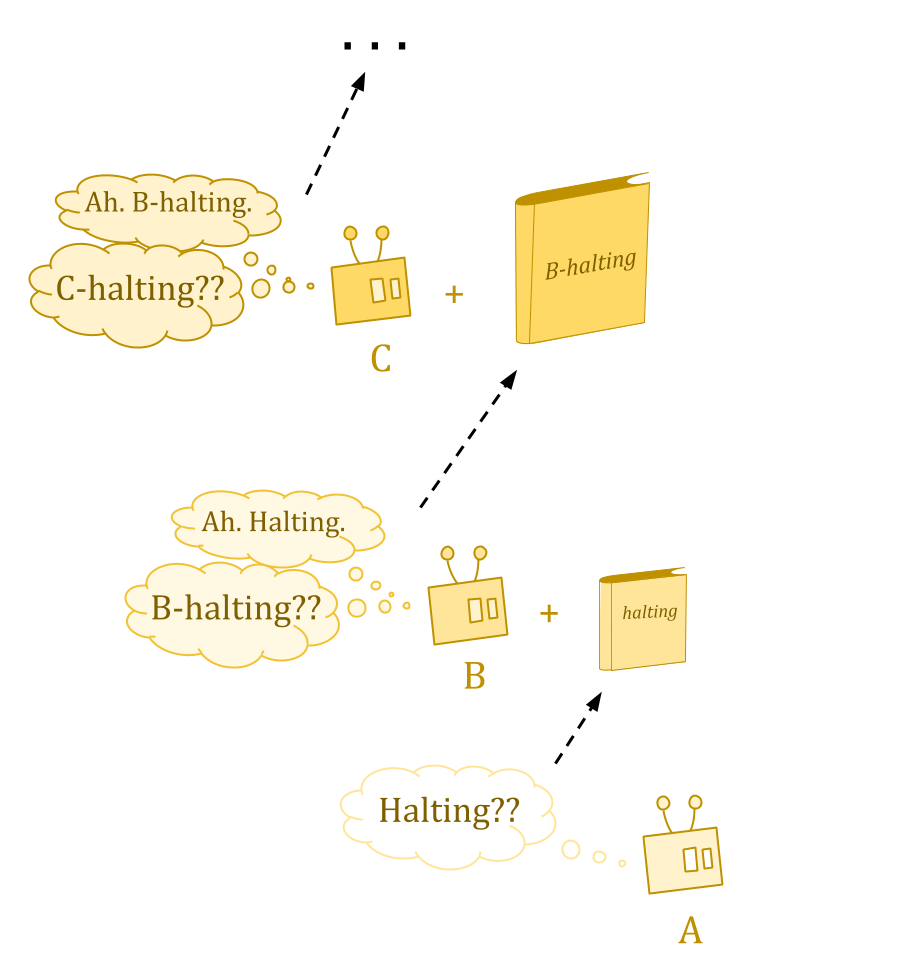

有一些问题是图灵机无法回答 - 特别是关于图灵机的行为的问题。停止问题是经典的例子。

图灵研究了“神谕机器”,看看如果我们能回答这些问题,会发生什么。神谕就像一本书,里面包含了一些我们以前无法回答的问题的答案。

但通常,我们得到等级制度.B型机器可以回答有关类型机器是否停止的问题,C类型的机器具有关于类型A和B的答案,等等,但没有机器有关于自己类型的答案。

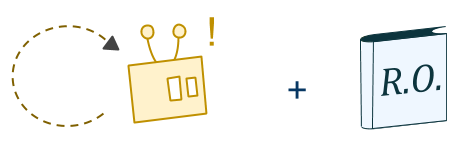

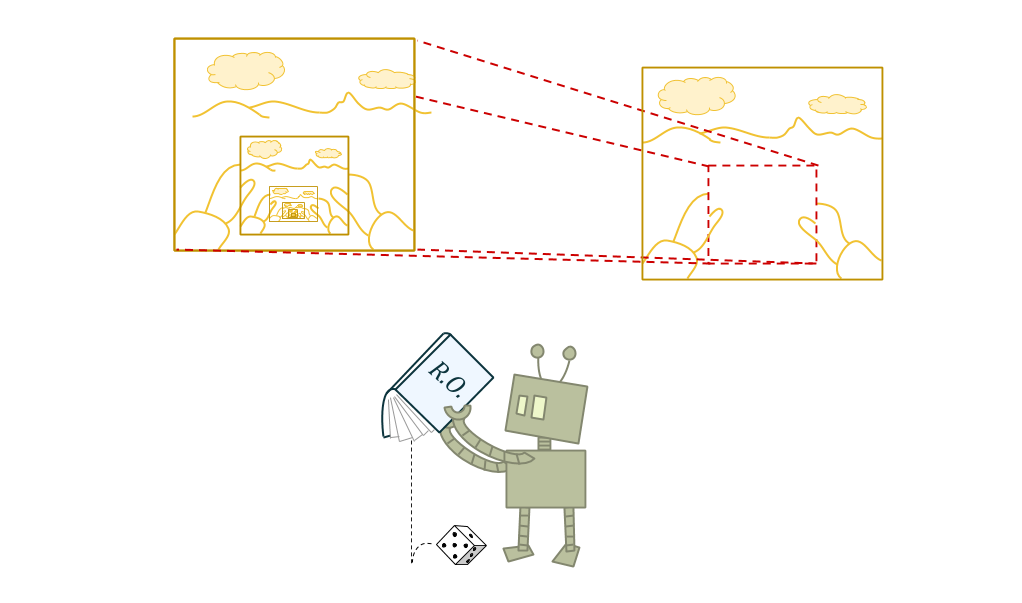

反思式神谕通过将普通的图灵宇宙扭曲回自身来工作,因此,你可以定义一个作为自己的神谕机器的神谕,而不是一个无限的更强大的神谕的层次结构。

这通常会引入矛盾,但反思神谕通过随机输出避免了这一点,因为它们会遇到悖论。所以反射式oracle机器是随机,但它们比常规随机图灵机更强大。

这就是反射性预言如何解决我们之前提到的地图本身也是领土的一部分的问题:随机化。

反光令人反光的袜子也解决了我前面提到的理性的游戏理论概念的问题。它允许代理以与环境的其他部分相同的方式进行推理,而不是将它们视为基本上特殊的情况。它们都只是计算 - oracle访问。

然而,基于反射岩石的理性剂的模型仍有几个主要限制。其中一个是代理商需要无限制的处理能力,就像AIXI一样,所以假设他们自己信仰的所有后果。

事实上,了解你的信仰的所有后果 - 一个被称为的财产逻辑不可用是经典贝叶斯理性的核心。

到目前为止,我一直以相当朴实的方式谈论关于假设的经纪人,而现实世界也是在假设空间中的相信。

这并不清楚任何意思。

取决于我们如何定义事物,它实际上可能是一个小于世界的代理,但仍包含正确的世界模型 - 它可能知道真实的物理和初始条件,而且只能推断出他们的后果大约。

人类当然习惯于使用速记和近似值。但是,尽管这种情况可能是现实的,但它并不符合贝叶斯定理通常的含义。贝叶斯定理知道所有信念的结果。

关于你信仰的后果的不确定性是逻辑不确定性.在这种情况下,行动者可能在经验上确定了一个独特的数学描述,确定了她所在的宇宙,但在逻辑上不确定该描述的大多数结果。

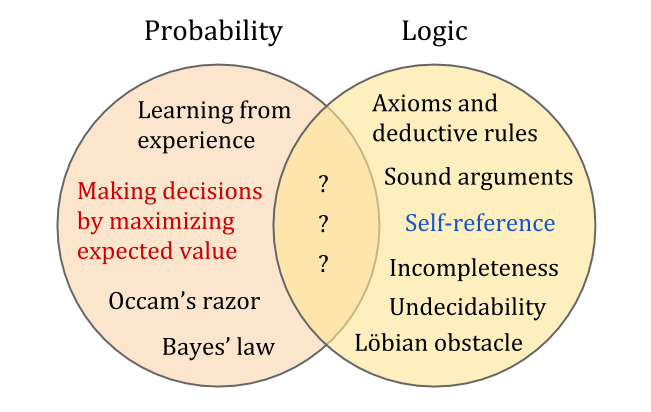

建模逻辑不确定性要求我们具有逻辑的组合理论(对含义的推理)和概率(信仰程度)。

逻辑和概率理论是合理思想编纂中的两个大胜利。逻辑提供了最佳思考工具自我参考,虽然概率提供了最佳的思考工具做决定.然而,这两个人不能一起工作,并且可以思考。

它们可能看起来是超级兼容的,因为概率理论是布尔逻辑的扩展。然而,Gödel的第一个不完整性定理表明,任何充分丰富的逻辑系统都是不完整的:它不仅可以将每个句子决定为真或假,但它也没有该可计算的延伸,该延伸也没有管理这样做。金宝博官方

(见帖子“插图:不可控制的数学家来进一步说明这是如何与概率论相混淆的。)

这也适用于概率分布:无可计算的分发可以以足够丰富的理论一致的方式分配概率。这迫使我们在使用之间选择联合国可计算分发,或使用不一致的分布。

听起来像一个简单的选择,对吗?不一致的理论至少是可计算的,我们毕竟试图制定逻辑理论非- 单独的。我们可以继续更新我们证明的事实,使我们更接近和更接近一致性。

不幸的是,由于与可实现性相关的原因,这并不是很好。记住,有没有可计算的概率分布与健全理论的所有结果一致。所以我们非无所不知的先验中连一个正确的都没有假设.

这会导致病理行为,因为我们对越来越真实的数学信仰。信仰狂风地振荡而不是接近合理的估计。

在数学之前服用贝叶斯,并更新任何我们证明的东西,似乎并不是捕获数学直觉和启发式猜想,除非我们在先前限制域并制作明智。

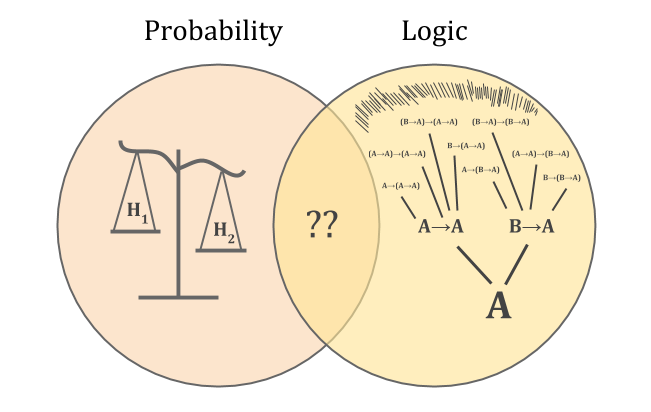

概率就像一个天平,以世界作为砝码。一个观察结果消除了一些可能的世界,消除了权重,改变了信念的平衡。

逻辑就像一棵树,根据推理规则从公理的种子中生长出来。对于现实世界的代理,成长的过程永远不会完成;你永远不知道每种信仰的所有后果。

不知道如何组合两者,我们无法对数学的推理概率表征。但“规模与树”问题也意味着我们不知道普通的经验推理是如何的。

贝叶斯假设检测要求每个假设清楚地宣布它分配到哪些观察的概率。这样,您知道在观察时重新缩小赔率的程度。如果我们不知道信仰的后果,我们不知道为预测提供多少信用。

这就像不知道把权重放在概率的天平上。我们可以试着在两边都加权重,直到一个证明排除了一个,但是这样信念就会永远振荡,而不是做任何有用的事情。

这迫使我们直面一个比主体更大的世界的问题。我们想要一些关于不确定结果的有限理性信念;但任何关于逻辑的可计算信念肯定被遗漏了某物,由于逻辑影响树将比任何容器都大大。

对于贝叶斯,概率的尺度正恰恰是平衡的没有荷兰书可以反对他们 - 没有肯定损失的赌注序列。但如果您知道您的信仰的所有后果,您只能占所有荷兰书籍。缺席,探索树的其他部分的人可以荷兰语 - 书写你。

但人类数学家似乎并没有遇到任何特殊的困难,而是在数学不确定性的推理中,不仅仅是我们对经验不确定性的影响。那么在数学不确定性下表征了良好的推理,如果没有豁免赌注的豁免?

一个答案是削弱荷兰书籍的概念,以便我们只允许基于赌注快速可计算树的一部分。这是Garrabrant等人的想法之一。“逻辑归纳“,早期尝试定义像”所罗门组织诱导的东西,而是融合数学不确定性的推理“。

这一事实的另一个结果是世界比你大的是你需要能够使用高级世界模型:包括桌子和椅子的模型。

这与经典符号的根基问题有关;但是因为我们想要一个形式分析来增加我们的相信在某些系统中,我金宝博官方们兴趣的模型有点不同。这也涉及透明度和知情监督:世界模型应该由可理解的部分组成。

一个相关的问题是高级推理和低级推理如何互相涉及和中级级别:多级世界模型.

标准概率推理并不能很好地解释这类事情。就好像你有不同的贝叶斯网,它们以不同的精度描述世界,处理能力的限制迫使你大多使用不太精确的,所以你必须决定如何根据需要跳转到更精确的。

此外,不同级别的模型不会完美地排列,因此您有一个翻译之间的问题;而模型可能会在它们之间存在严重矛盾。这可能是很好的,因为高级模型被理解为近似,或者它可能在更高或更低级模型中发出严重问题,需要他们的修订。

尤其有趣的是本体论的危机,我们重视的物体不作为世界的“更好”模型的一部分。

似乎公平地说,人类价值的一切仅存在于高级模型,从减少的角度来看,这是比原子和夸克的“不太真实”。然而,因为我们的价值观在低级别上没有定义,即使我们对较低级别的换档的了解,也能够保持我们的价值观。(我们也希望能够说出关于价值观发生的事情高的水平彻底移位。)

嵌入式世界模型的另一个关键方面是,主体自身必须在模型中,因为主体寻求理解世界,而世界不能完全与自己分离。这就打开了困难问题的大门自我参考和人为决策理论.

归化诱导是学习世界型号的问题,包括在环境中的自己。这是具有挑战性的,因为(作为Caspar Oestereld把它放了)“精神上的东西”和“物理物品”之间存在一种不匹配。

艾西认为环境似乎是代理适合的槽.我们可能直观地理解这种方式,但我们也可以理解这种情况,这看起来像一个不好的模型。我们可能会想象代理人分开代表:自我知识提供内省;关于宇宙的样子的假设;和一个“桥接假设“连接两者。

这其中有一些有趣的问题。还有一个问题是,这是不是正确的结构。这肯定不是我想象中的婴儿学习的方式。

托马斯纳格尔我会说,这种处理问题的方式涉及到“凭空的观点”;每一种假说都假设了一个从外面看的世界。这也许是一件奇怪的事。

需要对自身进行推理的一种特殊情况是需要对自身进行推理的未来自己.

为了制定长期计划,代理商需要能够模拟他们将如何行动,并具有某种相信在他们未来的目标和推理能力。这包括相信未来的自己,他们已经学到了很多,也成长了很多。

在传统的贝叶斯框架中,“学习”意味着贝叶斯更新。但是我们注意到,贝叶斯更新要求代理开始大到足以考虑世界的各种可能方式,并通过排除其中一些来学习。

嵌入式代理需要资源有限公司那逻辑上不确定的更新,不像这样工作。

不幸的是,贝叶斯更新是我们知道如何考虑通过时间作为一个统一代理的代理商的主要方式。荷兰语推理的荷兰书籍理由基本上说这种更新是没有代理人在周一工作的唯一途径,至少有一点,在周二到代理人的行动。

嵌入式代理人是非贝叶斯。非贝叶斯代理商倾向于与未来的自我变成战争。

这为我们带来了下一系列问题:强大的代表团.

你喜欢这个帖子吗?你可以享受我们的其他分析帖子,包括: